서울대 조요한 교수님 Conversational AI 12강 정리

외부 knowledge에 grounding 시키기!

1. Knowledge in Text

knowledge finetuning

wizard of wikipedia - chit-chat dataset -> 되게 많이 쓰임

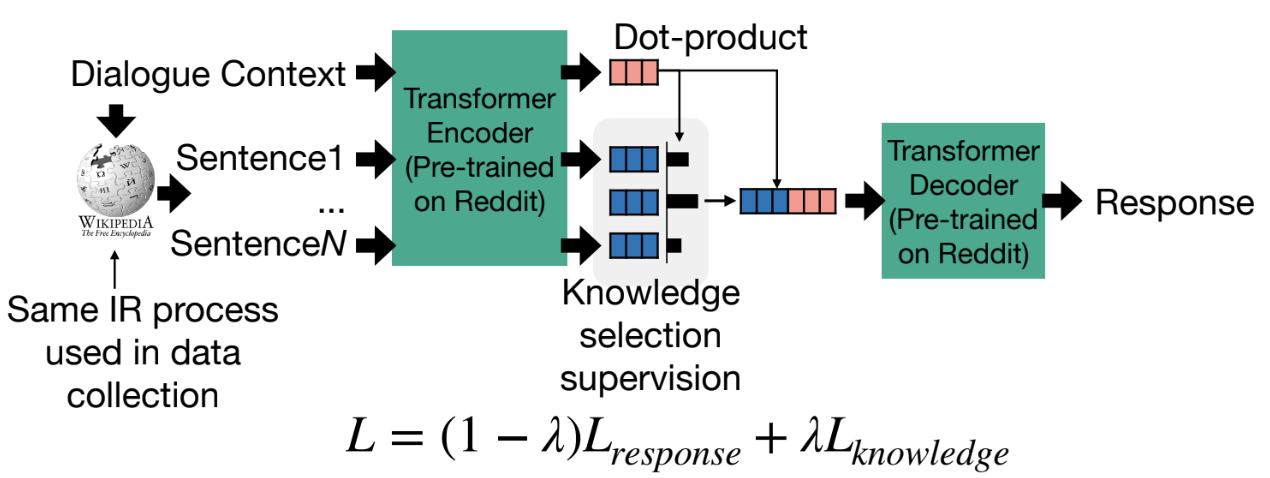

1) end-to-end generative model

[질문]

loss 계산에서 보통 람다값을 몇으로 설정하나요?

response loss랑 knowledge loss 중 무엇에 비중을 더 두는지

2) two-stage generative model

end-to-end보다 성능 좋았다!

knowledge dropout이 성능 더 높였다

knowledge incorporation != human liking

2. Knowledge in Graph

외부에 있는 그래프 형태 knowledge 가져와서 사용하기

1) Node

2) Edge

3) Triple (head, relation, tail)

- head: 시작 노드

- relation: 방향 edge

- tail: 끝 노드

4) path: 특정 노드에서 어떤 노드까지 가는 길

- N-hop node: Num of relations in the path

1) popular knowledge graphs

(1) Wikidata

(2) DBpedia

(3) ConceptNet

(4) Freebase: 과거에 많이 쓰임

2)dataset

OpenDialKG

3) entity/relation embeddings

[질문]

그래프 임베딩 구하는 방식이 잘 이해가 안 가는데

(노드, 릴레이션, 노드) 트리플이 KG에 존재한다 안한다를 분류하는 binary classification 과정에서 구해지는 내부 vector가 맞는지.

-> 그렇다면 이 그래프 임베딩은 구체적으로 어떤 정보를 담게 되는 것인지?

-> 다른 그래프 임베딩 기법으로는 무엇이 있나요?